纺织品有潜力通过改善美观度、舒适度和人体工程学,帮助技术融入我们的日常环境和物品中。消费设备已开始通过织物覆盖的智能扬声器和编织耳机线利用这些机会,而材料和柔性电子产品的进步已使传感和显示功能能够融入夹克、连衣裙和毛毯等柔软的外形中。

一种可扩展的交互式电子纺织架构,具有嵌入式触摸感应、手势识别和视觉反馈。

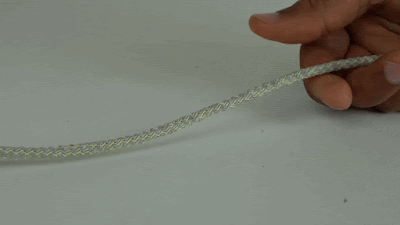

在“电子纺织品微交互”( ACM CHI 2020论文集)中,我们为软设备带来了交互性,并展示了机器学习 (ML) 如何与交互式纺织品拓扑相结合,实现离散和连续手势的并行使用。这项工作扩展了我们之前推出的电子纺织品架构( ACM UIST 2018论文集)。这项研究的重点是绳索,因为它们可以模块化地用作服装中的拉绳,也可以用作消费设备之间数据和电源的有线连接。通过利用纺织品编织技术,我们通过重复矩阵拓扑在表面集成了手势感应和视觉反馈。

要了解其工作原理,请观看有关电子纺织品微交互的视频 和有关电子纺织品架构的视频。

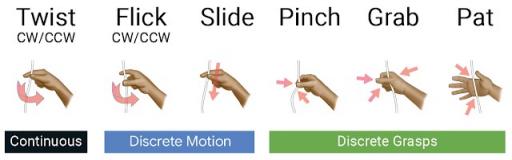

电子纺织微交互将连续感应与离散运动和抓握相结合。

螺旋传感矩阵 (HSM)

编织通常是指三条或更多条材料线的对角交织。虽然编织物传统上用于美观和结构完整性,但它们也可用于实现新的传感和显示功能。尽管可以通过电容感应

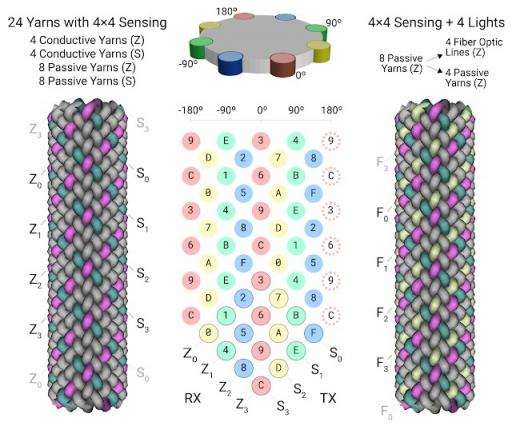

制作绳索来检测基本的触摸手势,但我们开发了螺旋传感矩阵(HSM),以实现更大的手势空间。HSM 是由电绝缘的导电纺织纱线和无源支撑纱线组成的编织物,其中相反方向的导电纱线充当发射和接收电极,以实现相互的电容感应。它们交叉点处的电容耦合由用户的手指调节,并且由于编织图案沿长度重复,因此可以在绳索上的任何位置感应到这些相互作用。

左图: 基于 4×4 编织物的螺旋传感矩阵(8 条导电线绕在芯线上)。洋红色/青色是导电纱线,用作接收/发送线。灰色是被动纱线(棉)。 中间: 扁平矩阵,显示了无数个 4×4 矩阵(彩色圆圈 0-F),它们沿着绳索的长度重复。 右图: 黄色是光纤线,提供视觉反馈。

旋转检测

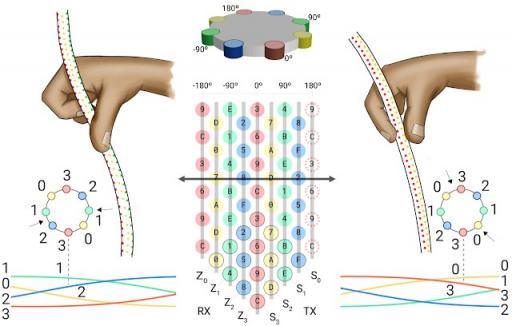

一个关键的见解是,HSM 中共用一组电极(以及扁平矩阵图中的颜色)的两个轴向柱彼此成 180º 角。因此,捏和滚动脐带会激活一组电极,并使我们能够跟踪这些柱之间的相对运动。旋转检测可识别相对于偏移 90º 的一组时变正弦信号的当前相位。编织物允许用户在任何地方启动旋转,并且可以通过一组小型电极进行扩展。

旋转是根据手指在柱子上的水平运动推断出来的。下图显示了相对电容信号强度,该强度会随着手指接近而变化。

交互技术和设计指南

这种电子纺织品结构使线具有触摸感应功能,但与刚性触摸表面相比,其柔软性和延展性限制了合适的交互。考虑到这种独特的材料,我们的设计指南强调:

简单的手势。我们设计了简短的交互,用户既可以做出单个离散手势,也可以执行连续操作。

闭环反馈。我们希望帮助用户发现功能并持续获得对其操作的反馈。在可能的情况下,我们会在设备中集成视觉、触觉和音频反馈。

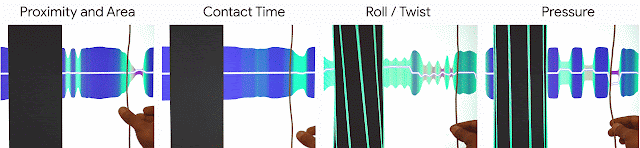

基于这些原则,我们利用我们的电子纺织品架构来实现基于我们感知接近度、面积、接触时间、滚动和压力的能力的交互技术。

我们的电子纺织品能够基于接近度、接触面积、接触时间、滚动和压力的电容感应实现交互。

可以显示不同强度颜色的光纤线可以为用户提供动态实时反馈。

编织的光纤线创造了定向运动的幻觉。

动作手势(轻弹和滑动)和抓握方式(捏、抓、捏)

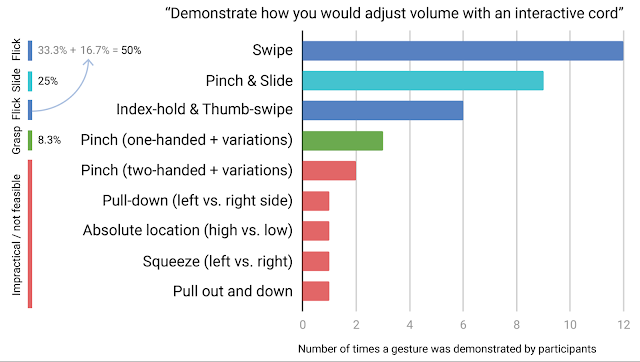

我们进行了一项手势诱导研究,结果显示手势组合有扩展空间。受这些结果的启发,我们决定研究基于轻弹和滑动的五种动作手势以及单点触摸手势(捏、抓和拍)。

通过想象的触觉感知进行手势引发研究。

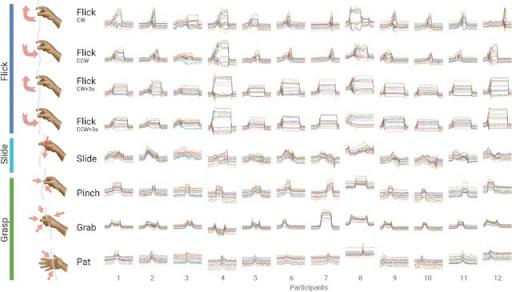

我们收集了 12 位新参与者的数据,共得到 864 个手势样本(12 位参与者每人执行 8 个手势,重复 9 次),每个手势样本有 16 个特征,这些特征随时间线性插值到 80 个观测值中。参与者以自己的风格执行这 8 个手势,没有反馈,因为我们希望适应个体差异,因为分类高度依赖于用户风格(“接触”)、偏好(“如何捏/抓”)和解剖结构(例如手的大小)。因此,我们的流程设计为用户相关的训练,以支持参与者之间存在差异的个人风格,例如顺时针/逆时针使用不一致、时间手势重叠(例如轻拂与轻拂并保持,以及类似的捏和抓手势)。对于独立于用户的系统,我们需要解决这些差异,例如使用更严格的一致性指令、来自更大群体的数据以及更多样化的环境。训练期间的实时反馈也将有助于减轻差异,因为用户会学会调整自己的行为。

十二名参与者(横轴)对八个手势(纵轴)进行了 9 次重复(动画)。每个子图像显示 16 个叠加特征向量,随时间推移插入 80 个观测值。

我们对每个用户的手势进行了交叉验证,通过对八次重复进行训练,对一次重复进行测试,通过九次排列,实现了约 94% 的手势识别准确率。这个结果令人鼓舞,特别是考虑到如此低分辨率传感器矩阵(八个电极)所实现的表现力。

值得注意的是,重复传感矩阵中的固有关系非常适合机器学习分类。我们研究中使用的 ML 分类器能够使用有限的数据进行快速训练,这使得依赖于用户的交互系统变得合理。根据我们的经验,典型手势的训练时间不到 30 秒,这与训练指纹传感器所需的时间相当。

独立于用户的连续扭转:量化精度和速度

每个用户训练的手势识别启用了八个新的离散手势。对于连续交互,我们还希望量化独立于用户的连续扭转在精确任务中的表现。我们将我们的电子纺织品与两个基线进行了比较,一个是电容式多点触控触控板(“滚动”),另一个是熟悉的耳机线遥控器(“按钮”)。我们设计了一项实验室研究,其中三种设备在目标任务中控制 1D 运动。

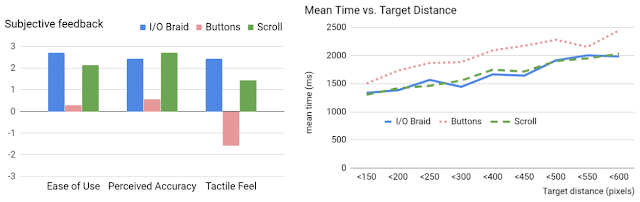

我们分析了 1800 次试验的三个因变量,涵盖 12 名参与者和三种技术:任务时间(毫秒)、总运动和试验结束时的运动。参与者还通过排名和评论提供定性反馈。

我们的定量分析表明,我们的电子纺织品的扭曲速度比现有的耳机按钮控制更快,速度与触摸表面相当。定性反馈还表明,与耳机控制相比,人们更喜欢电子纺织品交互。

左图:加权平均主观反馈。我们将 7 点李克特量表映射到 [-3, 3] 范围内的分数,并乘以该技术获得该评分的次数,然后计算所有分数的平均值。右图:目标距离的平均完成时间表明,按钮始终较慢。

鉴于我们的电子纺织品比刚性输入设备更灵敏,这些结果尤其有趣。一种解释可能是它的表现力——用户可以快速或缓慢地扭动电线上的任意位置,并且动作是对称且可逆的。耳机上的传统按钮需要用户找到它们的位置并改变握法进行操作,这会增加按错按钮的成本。我们使用高通滤波器来限制意外的皮肤接触,但还需要进一步研究以表征稳健性并评估在实际使用环境中的长期性能。

手势原型:耳机、连帽衫拉绳和扬声器线

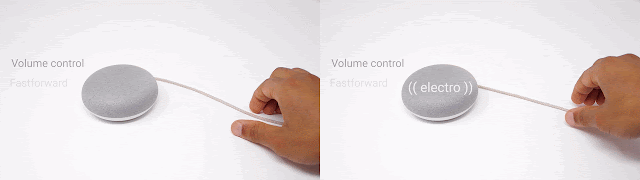

我们开发了不同的原型来展示我们的电子纺织品架构的功能:用于控制手机媒体播放的电子纺织品 USB-C 耳机、用于在衣服上隐形添加音乐控制的连帽衫拉绳以及用于手势控制智能扬声器的交互式电线。

左:轻按 = 播放/暂停;中: 双击 = 下一曲目;右:滚动 = 音量 +/-

交互式扬声器线,可同时使用连续(扭转/滚动)和离散手势(捏/拍)来控制音乐播放。

结论和未来方向

我们引入了一种用于嵌入式传感和视觉反馈的交互式电子纺织品架构,该架构可以在紧凑的绳索外形中实现精确的小规模和大规模运动。通过这项工作,我们希望推进纺织品用户界面,并启发未来可穿戴界面和智能织物使用微交互,从而实现无需眼睛的访问和随意、紧凑和高效的输入。我们希望我们的电子纺织品能够激励其他人使用可扩展的技术来增强物理对象,同时保留工业设计和美感。

致谢

这项工作是 Google 多个团队合作的成果。该项目的主要贡献者包括 Alex Olwal、Thad Starner、Jon Moeller、Greg Priest-Dorman、Ben Carroll 和 Gowa Mainini。我们感谢 Google ATAP Jacquard 团队的合作,特别是 Shiho Fukuhara、Munehiko Sato 和 Ivan Poupyrev。我们特别感谢 Google Wearables,以及 Kenneth Albanowski 和 Karissa Sawyer。最后,我们要感谢 Mark Zarich 的插图、Bryan Allen 的摄像、Frank Li 的数据处理、Mathieu Le Goc 的宝贵讨论以及 Carolyn Priest-Dorman 的纺织建议。

评论