联邦学习于2017 年推出,它使开发人员能够在许多设备上训练机器学习 (ML) 模型,而无需集中数据收集,从而确保只有用户拥有其数据的副本,并用于支持诸如在Android 版 Gboard中建议下一个单词和表达以及提高Android 信息中智能回复的质量等体验。随着这些应用程序的成功,人们越来越有兴趣使用联邦技术来回答有关分散数据的更基本问题 - 例如计算计数或费率 - 而这些问题通常根本不涉及 ML。通过这些技术分析用户行为可以带来更好的产品,但必须确保基础数据的私密性和安全性。

今天,我们将介绍联邦分析,即应用数据科学方法分析存储在用户设备本地的原始数据的实践。与联邦学习一样,联邦分析的工作原理是对每台设备的数据进行本地计算,并且只向产品工程师提供汇总结果(而不会提供来自特定设备的任何数据)。然而,与联邦学习不同的是,联邦分析旨在支持基本的数据科学需求。这篇文章介绍了在追求联邦学习的过程中开发的联邦分析的基本方法,我们如何将这些见解扩展到新领域,以及联邦技术的最新进展如何为日益广泛的数据科学需求提供更高的准确性和隐私性。

联邦分析的起源

对联邦分析的首次探索是为了支持联邦学习:当数据中心没有真实数据时,工程师如何根据这些数据衡量联邦学习模型的质量?答案是重新使用联邦学习基础设施,但不使用学习部分。在联邦学习中,模型定义不仅可以包括要优化的损失函数,还可以包括用于计算指示模型预测质量的指标的代码。我们可以使用此代码直接评估手机数据的模型质量。

例如,Gboard 工程师根据用户手机上保存的原始输入数据测量了下一个单词预测模型的整体质量。参与的手机下载了一个候选模型,在本地计算了模型预测与实际输入单词的匹配程度的指标,然后上传了该指标,而无需调整模型的权重或对 Gboard 输入体验进行任何更改。通过对多部手机上传的指标进行平均,工程师可以了解模型性能的总体水平摘要。该技术还可以轻松扩展以估计数据集大小等基本统计数据。

歌曲识别测量的联合分析

除了模型评估之外,联合分析还用于支持Google Pixel 手机上的“正在播放”功能,该工具可向您显示您周围房间中正在播放的歌曲。在底层,“正在播放”使用设备上的歌曲指纹数据库来识别手机附近播放的音乐,而无需网络连接。该架构有利于隐私和用户 - 它速度快,可离线工作,并且不会有任何原始或处理过的音频数据离开手机。由于一个地区的每部手机都接收相同的数据库,并且只能识别数据库中的歌曲,因此数据库保存正确的歌曲非常重要。

为了衡量和改进每个区域数据库的质量,工程师需要回答一个基本问题:哪些歌曲最常被识别?联合分析提供了答案,但不会透露任何单个手机听过哪些歌曲。它适用于同意向 Google 发送设备相关使用情况和诊断信息的用户。

当“闻曲知音”识别出一首歌曲时,它会将曲目名称记录到设备上的“闻曲知音”历史记录中,用户可以在其中查看最近识别的歌曲并将其添加到音乐应用的播放列表中。稍后,当手机处于空闲状态、插入电源并连接到 WiFi 时,谷歌的联合学习和分析服务器可能会邀请该手机与其他几百部手机一起加入一“轮”联合分析计算。这一轮中的每部手机都会计算其“闻曲知音”历史记录中歌曲的识别率,并使用安全聚合协议对结果进行加密。加密后的识别率会发送到联合分析服务器,该服务器没有单独解密的密钥。但当将这些数据与这一轮中其他手机的加密计数相结合时,服务器就可以解密所有歌曲计数的最终结果(仅此而已)。

这一结果使 Google 工程师能够改进歌曲数据库(例如,确保数据库包含真正流行的歌曲),而无需任何手机透露听过哪些歌曲。在第一次改进迭代中,全球所有 Pixel 手机的歌曲识别率整体提高了 5%。

使用安全聚合保护联合分析

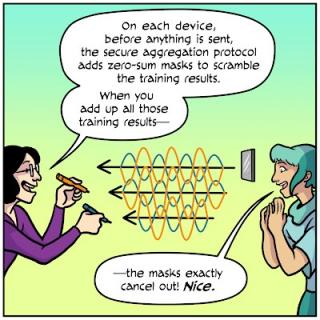

安全聚合可以为联邦分析应用程序提供更强的隐私属性。为了直观地了解安全聚合协议,请考虑一个更简单版本的歌曲识别测量问题。假设 Rakshita 想知道她的朋友 Emily 和 Zheng 听了某首歌的频率。Emily 听过这首歌S Emily次,而 Zheng 听了S Zheng次,但他们都不愿意与 Rakshita 或彼此分享他们的计数。相反,这三人可以进行安全聚合:Emily 和 Zheng 见面决定一个随机数M,并对 Rakshita 保密。Emily 向 Rakshita 透露和S Emily + M,而 Zheng 透露差值S Zheng - M。Rakshita 看到两个实际上是随机的数(它们被M掩盖了),但她可以将它们相加 ( S Emily + M ) + ( S Zheng - M ) = S Emily + S Zheng ,以揭示 Emily 和 Zheng 听这首歌的总次数。

这种方法的隐私属性可以通过对更多人进行求和或在计数中添加小的随机值来增强(例如,支持差异隐私)。对于“正在播放”,数百台设备的歌曲识别率被加在一起,然后才向工程师公布结果。

安全聚合协议的图示,来自联邦学习漫画书。

实现更高隐私性的学习和分析

联合分析方法是一个活跃的研究领域,已经超越了分析指标和计数的范围。有时,使用联合学习训练 ML 模型可用于获取有关设备上数据的综合见解,而无需将任何原始数据离开设备。例如,Gboard 工程师希望发现用户经常输入的新词,并将它们添加到用于拼写检查和输入建议的词典中,而所有这些都无法看到用户输入的任何单词。他们通过在手机上训练字符级循环神经网络来实现这一点,只使用这些手机上输入的尚未收录在全局词典中的单词。输入的单词从未离开过手机,但生成的模型随后可以在数据中心用于生成经常输入的字符序列样本 - 新词!

我们还在开发技术,通过训练联合生成模型来回答有关分散数据集的更模糊的问题,例如“我的模型难以识别数据中的哪些模式? ”。我们正在探索应用用户级差异隐私模型训练的方法,以进一步确保这些模型不会对任何单个用户独有的信息进行编码。

Google 恪守隐私原则,这意味着要推动保护用户数据的最新技术,无论是通过数据中心的差异隐私,还是数据收集过程中隐私的进步。Google 最早的去中心化数据分析系统 RAPPOR于 2014 年推出,自那时起,我们学到了很多即使在存在大量噪音(通常是为实现本地差异隐私而引入的)的情况下也能做出有效决策的方法。联合分析继续了这项工作。

联合分析方法仍处于早期阶段,需要取得更多进展才能准确回答许多常见的数据科学问题。最近的《联合学习的进展和未解决的问题》论文对联合研究进行了全面调查,而《具有差异隐私的联合重磅发现》介绍了一种联合分析方法,用于发现数据集中最频繁的项目。联合分析使我们能够以不同的方式思考数据科学,以分散数据和保护隐私的聚合为中心。我们欢迎在这个新兴领域做出新的贡献和扩展。

致谢

这篇文章反映了许多人的工作,包括 Blaise Agüera y Arcas、Galen Andrew、Sean Augenstein、Françoise Beaufays、Kallista Bonawitz、Mingqing Chen、Hubert Eichner、Úlfar Erlingsson、Christian Frank、Anna Goralska、Marco Gruteser、Alex Ingerman、Vladimir Ivanov , 彼得·凯鲁兹, 克洛伊·基登, 本·克鲁特, 艾莉森·伦茨, 李伟, 刘旭, 安东尼奥·马塞多内, 拉吉夫·马修斯, 布伦丹·麦克马汉, 汤姆·欧阳, 萨瓦·帕特尔, 斯瓦鲁普·拉马斯瓦米, 亚伦·西格尔, 卡恩·塞斯, 孙海城, 蒂蒙·范·奥弗维尔特,谢尔盖·瓦西尔维茨基、斯科特·韦格纳、张远波、张莉和朱文楠。

评论