随着人工智能 (AI) 越来越成为我们日常生活中不可或缺的一部分,了解和降低与其部署相关的风险至关重要。为了观察、记录、报告并从人工智能系统的问题和故障中吸取教训,我们需要使用通用术语来描述它们。如今,这些事件被广泛称为人工智能事件。全球举措的最新进展旨在标准化我们报告和监控人工智能事件和危害的方式,为更好的治理和更安全的人工智能实施铺平道路。

定义人工智能事件和相关术语

第一步是将人工智能事件和危害标准化。OECD 和 OECD.AI 专家网络正在牵头这项工作,提出了对人工智能相关事件和危害进行分类的初步定义,这些定义包含在新发布的《定义人工智能事件和相关术语》论文中。

这些定义是OECD.AI 人工智能事件专家组所有利益相关方的人工智能专家和 OECD 人工智能治理工作组 (AIGO) 的政策制定者经过 18 个月多的深思熟虑的结果。他们参考了《人工智能事件定义发展盘点》报告,该报告分析了与跨行业事件定义相关的术语,以构建制定人工智能事件定义的基础知识库。

这些定义对于确保不同司法管辖区的监管机构达成共识和参考点至关重要,这样他们就可以共同努力,以相同的参考点降低风险和危害。这就是所谓的互操作性。同时,起草这些定义是为了为各司法管辖区提供灵活性,以确定他们希望解决的人工智能事件和危害的范围。

人工智能事故始于伤害

危害是技术标准和法规的核心概念,这些标准和法规针对的是事件,危害定义和分类法通常针对具体情况。事件定义通常侧重于潜在危害、实际危害或两者兼而有之。定义危害并评估其类型、严重程度和其他相关维度(例如范围、地理范围、可量化性等)对于识别导致或可能导致危害的事件至关重要。制定有效的框架来解决这些问题也至关重要。

定义人工智能危害的类型、严重程度和其他维度是制定人工智能事件定义的先决条件。危害有多种类型,例如身体危害、心理危害、经济危害等,严重程度也有多种程度,例如无关紧要的危害、财产损失、健康危害、关键基础设施影响、人员死亡等。

损害的某些方面可能是可以量化的,例如经济损失或受影响的人数。其他方面可能更难量化,例如声誉损害。损害可以是有形的,例如对人的身体伤害或对财产或环境的破坏。有些损害,例如心理损害,可能不那么有形或容易量化。损害的范围和规模——无论它影响个人、组织、社会还是环境,也无论它发生在地方、国家还是国际层面——也很重要。损害的其他方面包括再次发生的可能性和可逆性。

完整、准确的人工智能事件和危害定义应该涵盖危害的各个方面。

实际危害与潜在危害

潜在危害是发生危害或损害的风险或可能性。风险是事件发生概率和后果严重程度的函数。例如,如果化工厂位于人口密集的地区,则化工厂发生爆炸的风险更大,爆炸的后果会很严重。识别和解决开发和使用人工智能风险管理系统和人工智能事件报告框架可能产生的风险和危害至关重要。潜在危害通常与危害概念相关。

实际伤害是实际伤害的风险。标准和法规中对实际伤害的定义在很大程度上取决于具体情况。它们通常侧重于人身伤害或健康、财产或环境损害。实际伤害通常与事件概念相关。

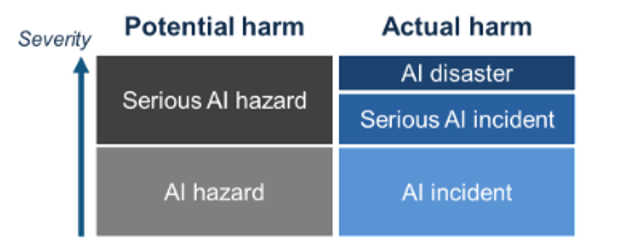

根据危害严重程度对人工智能事件和危害进行分类的建议

核心定义

人工智能系统的开发或使用导致实际伤害的事件被称为“人工智能事件”,而人工智能系统的开发或使用可能造成伤害的事件被称为“人工智能危害”。经合组织提出的定义如下:

“人工智能事件是指一个或多个人工智能系统的开发、使用或故障直接或间接导致以下任何危害的事件、情况或一系列事件:

(a) 对个人或群体的健康造成伤害或损害;

(b)扰乱关键基础设施的管理和运行;

(c) 侵犯人权或违反适用法律规定的保护基本权利、劳工权利和知识产权的义务;

(d) 对财产、社区或环境造成损害。”

“人工智能危害是指一个或多个人工智能系统的开发、使用或故障可能导致人工智能事件的事件、情况或一系列事件,即以下任何危害:

(a) 对个人或群体的健康造成伤害或损害;

(b)扰乱关键基础设施的管理和运行;

(c) 侵犯人权或违反适用法律规定的保护基本权利、劳工权利和知识产权的义务;

(d) 对财产、社区或环境造成损害。”

报告还提出了与事件和危害相关的术语定义,例如严重人工智能事件、人工智能灾难和严重人工智能危害。这些拟议定义旨在阐明什么是人工智能事件、危害和相关术语,但又不至于过于规范。

推动建立共同报告框架

这些定义将促成一个统一的系统,允许跨司法管辖区和部门一致、全面地报告和监控人工智能事件。这是跟踪和分析事件以及构建一个预测和主动预防事件的环境的基础。通过了解事件的类型和频率,政策制定者可以制定更有效的法规和指导方针,以防止重复和未来发生此类事件。

迈向通用人工智能事故报告框架的举措代表着全球在确保人工智能系统安全性和可靠性方面迈出了重要一步。通过标准化定义和报告机制,经合组织正在帮助更好地管理人工智能的社会影响。

追踪真实的人工智能事件可以为制定人工智能政策提供证据基础

经合组织制定了全球人工智能事件监测系统( AIM ),以实时收集人工智能事件,这些事件来自可用的公共资源,并为制定人工智能事件定义和报告框架的更多概念性工作提供信息。AIM 将有助于确定可能需要监管关注的人工智能应用、其影响以及失败的根本原因。它将能够对如果不采取纠正措施已经或可能出现的人工智能风险进行交互式比较和分析。这还可以帮助防止事件再次发生,并为政策制定和监管目的提供适当的证据。

本站全部资讯来源于实验室原创、合作机构投稿及网友汇集投稿,仅代表个人观点,不作为任何依据,转载联系作者并注明出处:https://www.lvsky.net/123.html

评论