慢跑、看书、倒水或运动等日常动作都可以看作是一系列姿势,由人体的位置和方向组成。理解图像和视频中的姿势是实现一系列应用的关键步骤,包括增强现实显示、全身手势控制和体育锻炼量化。然而,在图像和视频中以二维方式捕捉到的三维姿势会因相机的视点不同而有所不同。仅使用二维信息识别三维姿势相似性的能力将有助于视觉系统更好地理解世界。

在ECCV 2020的焦点论文 “视角不变的人体姿势概率嵌入”(Pr-VIPE)中,我们提出了一种新的人体姿势感知算法,该算法通过将2D 身体姿势关键点映射到视角不变的嵌入空间,识别不同摄像机视图中人体姿势的相似性。此功能可实现姿势检索、动作识别、动作视频同步等任务。与直接将 2D 姿势关键点映射到 3D 姿势关键点的现有模型相比,Pr-VIPE 嵌入空间 (1) 视角不变,(2) 是概率性的,以捕捉 2D 输入模糊性,以及 (3) 在训练或推理期间不需要相机参数。使用实验室设置数据进行训练后,只要有一个相当好的 2D 姿势估计器(例如PersonLab、BlazePose等),该模型就可以开箱即用地处理自然图像。该模型很简单,可以生成紧凑的嵌入,并且可以使用 15 个 CPU 进行训练(大约 1 天)。我们已在GitHub 存储库上发布了代码。

Pr-VIPE 可直接用于对齐不同视角的视频。

镨离子

Pr-VIPE 的输入是一组 2D 关键点,来自任何产生至少13 个身体关键点的 2D 姿势估计器,输出是姿势嵌入的均值和方差。2D 姿势嵌入之间的距离与它们在绝对 3D 姿势空间中的相似性相关。我们的方法基于两个观察结果:

随着视点的变化,相同的 3D 姿势在 2D 中可能会显得非常不同。

相同的 2D 姿势可以从不同的 3D 姿势 投影而来。

第一个观察结果激发了对视角不变性的需要。为了实现这一点,我们定义了匹配概率,即从相同或相似的 3D 姿势投射出不同 2D 姿势的可能性。Pr-VIPE 预测的匹配姿势对的匹配概率应该高于非匹配姿势对。

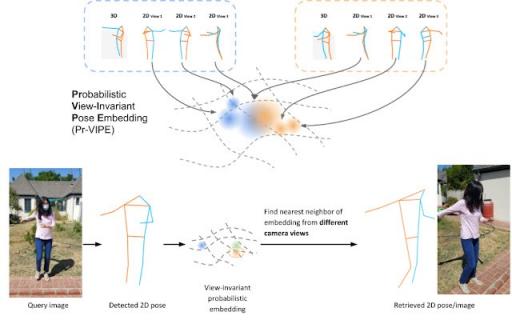

为了解决第二个观察结果,Pr-VIPE 采用了概率嵌入公式。由于许多 3D 姿势可以投射到相同或相似的 2D 姿势,因此模型输入表现出固有的模糊性,很难通过嵌入空间中的确定性点对点映射来捕获。因此,我们通过概率映射将 2D 姿势映射到嵌入分布,我们使用方差来表示输入 2D 姿势的不确定性。例如,在下图中,左侧 3D 姿势的第三个 2D 视图与右侧不同 3D 姿势的第一个 2D 视图相似,因此我们将它们映射到嵌入空间中具有较大方差的类似位置。

Pr-VIPE 使视觉系统能够识别不同视角的 2D 姿势。我们使用 Pr-VIPE 嵌入 2D 姿势,使得嵌入 (1) 具有视角不变性(类似 3D 姿势的 2D 投影紧密嵌入在一起)和 (2) 具有概率性。通过嵌入检测到的 2D 姿势,Pr-VIPE 可以直接检索不同视角的姿势图像,并且还可以应用于动作识别和视频对齐。

视角不变性

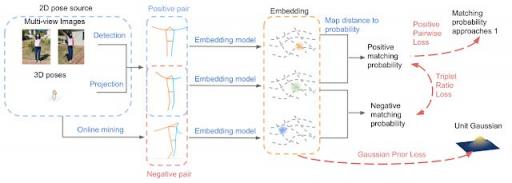

在训练过程中,我们使用来自两个来源的 2D 姿势:多视图图像和真实 3D 姿势的投影。从一批数据中选择 2D 姿势的三元组(锚点、正例和负例),其中锚点和正例是同一 3D 姿势的两个不同投影,而负例是非匹配 3D 姿势的投影。然后,Pr-VIPE 从其嵌入中估计 2D 姿势对的匹配概率。

在训练过程中,我们利用正对损失将正对的匹配概率推向接近 1,其中我们最小化正对之间的嵌入距离,利用三重态比率损失最大化正对和负对之间的匹配概率比率,使负对的匹配概率较小。

Pr-VIPE 模型概述。在训练期间,我们应用三种损失(三重比率损失、正成对损失和在嵌入之前应用单位高斯的先验损失)。在推理期间,模型将输入的 2D 姿势映射到概率的、视图不变的嵌入。

概率嵌入

Pr-VIPE 使用基于采样的方法将2D 姿势映射到多元高斯分布的 概率嵌入,以计算两个分布之间的相似度得分。在训练期间,我们使用高斯先验损失来正则化预测分布。

评估

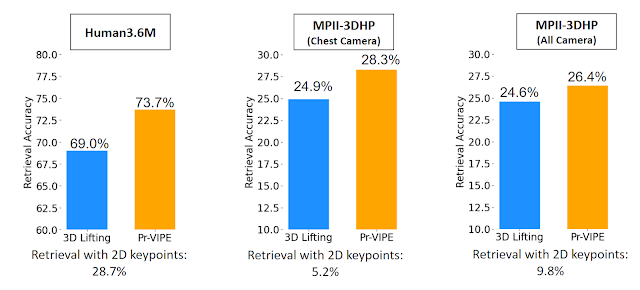

我们提出了一个新的跨视图姿势检索基准来评估嵌入的视图不变性。给定单目姿势图像,跨视图检索旨在从不同视图检索相同姿势,而无需使用相机参数。结果表明,与两个评估数据集(Human3.6M、MPI-INF-3DHP)中的基线方法相比,Pr-VIPE 可以更准确地跨视图检索姿势。

与基线方法(3D 姿势估计)相比,Pr-VIPE 可以更准确地检索不同视图中的姿势。

常见的 3D 姿态估计方法(例如上文用于比较的简单基线、 SemGCN和EpipolarPose等)会预测相机坐标中的 3D 姿态,而这些姿态并非直接与视角无关。因此,使用估计的 3D 姿态进行检索时,需要在每个查询-索引对之间进行严格对齐,这需要进行奇异值分解(SVD),因此计算成本很高。相比之下,Pr-VIPE 嵌入可以直接用于欧几里得空间中的距离计算,而无需任何后处理。

应用

视角不变姿势嵌入可应用于许多与图像和视频相关的任务。下面,我们展示了 Pr-VIPE 应用于不使用相机参数的野外图像跨视角检索。

通过使用 Pr-VIPE 嵌入检测到的 2D 姿势,我们可以从不同视角检索野生图像,而无需使用相机参数。使用查询图像(上行),我们从不同的相机视角搜索匹配的姿势,并显示最近邻检索(下行)。这使我们能够更轻松地跨相机视角搜索匹配的姿势。

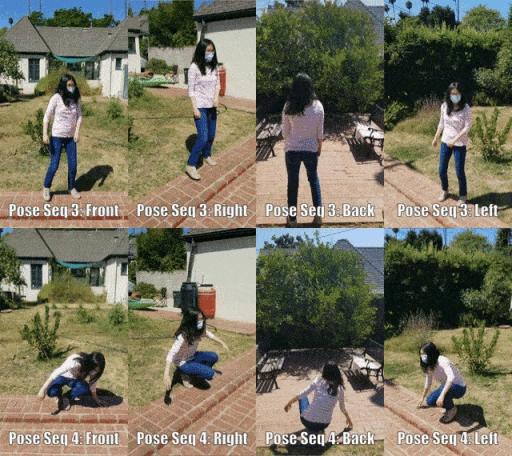

相同的 Pr-VIPE 模型也可用于视频对齐。为此,我们在一个小的时间窗口内堆叠 Pr-VIPE 嵌入,并使用动态时间规整(DTW) 算法来对齐视频对。

手动对齐视频非常困难且耗时。这里使用 Pr-VIPE 来自动对齐从不同视角重复的相同动作的视频。

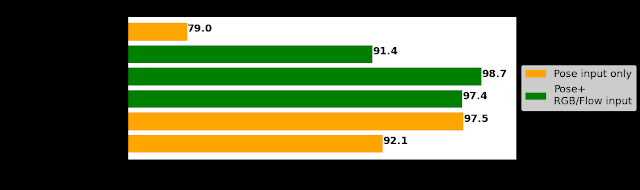

然后,可以使用 DTW 计算的视频对齐距离进行动作识别,方法是使用最近邻搜索对视频进行分类。我们使用Penn Action数据集评估 Pr-VIPE 嵌入,并证明使用 Pr-VIPE 嵌入而无需对目标数据集进行微调即可获得极具竞争力的识别准确率。此外,我们表明,Pr-VIPE 甚至仅使用索引集中单个视图的视频也能获得相对准确的结果。

Pr-VIPE 仅使用姿势输入即可识别跨视图的动作,并且与仅使用姿势或使用附加上下文信息的方法(例如Iqbal 等人、Liu 和 Yuan、Luvizon 等人和Du等人)相当或更好。当动作标签仅适用于单一视图的视频时,Pr-VIPE(仅限 1 个视图)仍然可以实现相对准确的结果。

结论

我们引入了 Pr-VIPE 模型,用于将 2D 人体姿势映射到视角不变的概率嵌入空间,并表明学习到的嵌入可直接用于姿势检索、动作识别和视频对齐。我们的跨视图检索基准可用于测试其他嵌入的视角不变属性。我们期待听到您使用姿势嵌入可以做什么!

致谢

特别感谢 Jiaping Zhao、Liang-Chieh Chen、Long Zhao(罗格斯大学)、Liangzhe Yuan、Yuxiao Wang、Florian Schroff、Hartwig Adam 以及 Mobile Vision 团队的精彩合作与支持。

评论