2021 年 6 月 2 日,美国职业棒球大联盟庆祝卢·格里格日,以纪念 1925 年卢·格里格成为洋基队首发一垒手的那一天,以及 1941 年他因肌萎缩侧索硬化症(ALS,又称卢·格里格病)去世,享年 37 岁。ALS 是一种渐进性神经退行性疾病,会影响运动神经元,运动神经元将大脑与全身肌肉连接起来,并控制肌肉控制和随意运动。当随意肌控制受到影响时,人们可能会失去说话、进食、移动和呼吸的能力。

为了纪念卢·格里格,因 ALS 而失去说话能力的前NFL球员、ALS 倡导者史蒂夫·格里森在 6 月 2 日的活动中用机器学习 (ML) 模型重现了格里格著名的“最幸运的人”演讲。格里森的语音重现是与谷歌的Euphonia 项目合作开发的,该项目旨在帮助因 ALS 而失去说话能力的人更好地用自己的声音交流。

今天我们来介绍一下 PnG NAT,这是 Euphonia 项目采用的模型,用于重现 Steve Gleason 的声音。PnG NAT 是一种新的文本转语音合成(TTS) 模型,它将两种最先进的技术PnG BERT和非注意力 Tacotron (NAT) 合并为一个模型。它比以前的技术表现出更好的质量和流畅度,代表了一种可以扩展到更广泛用户的有前途的方法。

重现声音

非注意力型 Tacotron (NAT) 是Tacotron 2的后继者,后者是 2017 年提出的序列到序列神经 TTS 模型。Tacotron 2 使用注意力模块连接输入文本序列和输出语音频谱图帧序列,这样模型就知道在生成合成语音频谱图的每个时间步骤时要注意文本的哪一部分。Tacotron 2 是第一个能够合成听起来像人说话一样自然的语音的 TTS 模型。然而,经过大量实验,我们发现,由于注意力机制固有的灵活性,模型可能会出现鲁棒性问题(如喋喋不休、重复或跳过部分文本),但这种可能性很小。

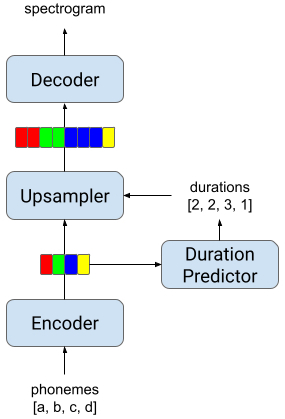

NAT 通过将注意力模块替换为基于持续时间的上采样器来改进 Tacotron 2,该上采样器会预测每个输入音素的持续时间并对编码的音素表示进行上采样,以便输出长度与预测的语音频谱图的长度相对应。这种改变既解决了稳健性问题,又提高了合成语音的自然度。这种方法还可以精确控制输入文本中每个音素的语音持续时间,同时仍保持高度自然的合成质量。由于 ALS 患者的录音通常表现为不流畅的语音,因此这种对每个音素进行控制的能力是实现重现语音流畅性的关键。

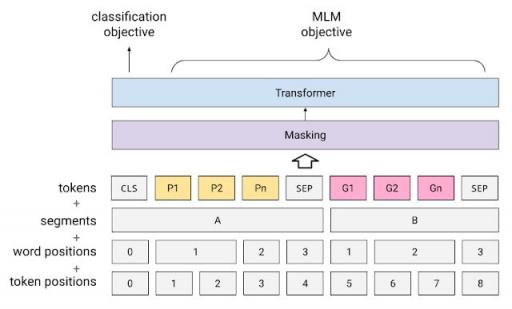

虽然 NAT 解决了稳健性问题并实现了神经 TTS 中的精确持续时间控制,但我们在此基础上进一步改进了对 TTS 输入的自然语言理解。为此,我们应用了 PnG BERT,它使用与BERT类似的方法,但专为 TTS 设计。它使用来自大型文本语料库的相同内容的音素表示和字素表示进行自我监督预训练,然后用作 TTS 模型的编码器。这可以显著改善合成语音的韵律和发音,尤其是在困难情况下。

两个模型的输入文本均为“要取消付款,请按 1;要继续,请按 2”。请注意两个版本中结尾“ two ”之前的停顿长度不同。常规 NAT 模型输出的版本中的单词“ two ”可能会与“ too ”混淆。由于“ too ”和“ two ”发音相同(因此音素表示也相同),因此常规 NAT 模型无法理解哪个更合适,并假定更常跟在逗号后面的单词“ too ”。相比之下,PnG NAT 模型可以更容易地分辨出差异,因为它除了音素外,还接受字素作为输入,从而做出更合适的停顿。

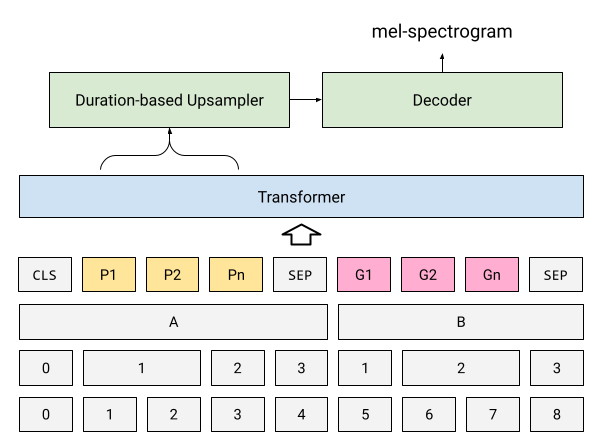

PnG NAT 模型将预训练的 PnG BERT 模型作为编码器集成到 NAT 模型中。NAT 使用编码器输出的隐藏表示来预测每个音素的持续时间,然后对其进行上采样以匹配音频频谱图的长度,如上所述。在最后一步中,非注意力解码器将上采样的隐藏表示转换为音频语音频谱图,最终由神经声码器将其转换为音频波形。

PnG BERT 和预训练目标。黄色框代表音素,粉色框代表字素。

PnG NAT:PnG BERT 取代了 NAT 模型中的原始编码器。删除了用于掩蔽语言模型 (MLM) 预训练的随机掩蔽。

为了重现史蒂夫·格里森的声音,我们首先用 31 位专业演讲者的录音训练了一个 PnG NAT 模型,然后用格里森 30 分钟的录音对其进行了微调。由于这些录音是在他被诊断患有 ALS 后录制的,因此它们显示出含糊不清的迹象。经过微调的模型能够合成听起来与这些录音非常相似的语音。然而,由于 ALS 的症状在格里森的讲话中已经存在,因此它们表现出一些类似的不流畅。

为了缓解这种情况,我们利用了 NAT 的音素持续时间控制以及由专业说话者训练的模型。我们首先预测专业说话者和 Gleason 的每个音素的持续时间,然后使用每个音素的两个持续时间的几何平均值来指导 NAT 输出。结果,该模型能够用 Gleason 的声音说话,但比原始录音更流利。

除了为 ALS 患者重现声音之外,PnG NAT 还通过Google Cloud Custom Voice 为各种客户提供声音支持。

和谐计划

全世界有数百万患有可能影响其言语能力的神经系统疾病的人,例如肌萎缩性脊髓侧索硬化症 (ALS)、脑瘫或唐氏综合症,许多人可能难以理解他人所说的话,这使得面对面交流变得具有挑战性。使用语音激活技术也可能令人沮丧,因为它们并不总是可靠。Euphonia项目是 Google Research 的一项计划,旨在帮助言语障碍者更好地理解他们所说的话。该团队正在研究如何提高言语障碍人士的语音识别能力(参见最近的博客文章和TODAY 节目中的片段),以及定制的文本转语音技术(参见以前 NFL 球员蒂姆·肖为主角 的《人工智能时代》纪录片)。

致谢

Google 研究、Google Cloud 和消费者应用以及 Google 无障碍团队的许多人士都为该项目和活动做出了贡献,其中包括 Michael Brenner、Bob MacDonald、Heiga Zen、Yu Zhang、Jonathan Shen、Isaac Elias、Yonghui Wu、Anne Keck、Danielle Notaro、Kevin Hogan、Zack Kaplan、KR Liu、Kyndra Price 和 Zoe Ortiz。

评论