三年前,我们撰写了一篇论文,介绍了 利用深度学习从眼底照片(即眼后部的照片)1预测多种心血管风险因素的工作。从眼底照片中提取此类风险因素是一项新发现,因此对于临床医生和外行人来说都是一个令人惊讶的结果。从那时起,我们和其他研究人员从眼底照片中发现了更多新的生物标志物,例如慢性肾病和糖尿病的标志物,以及用于检测贫血的血红蛋白水平。

此类工作的共同目标是开发新的疾病检测或监测方法,使其侵入性更小、更准确、更便宜、更容易获得。然而,从眼底照片中提取生物标记物的努力可能在人群层面上广泛应用,但其中一个限制因素是获取眼底照片本身,这需要专门的成像设备和训练有素的技术人员。

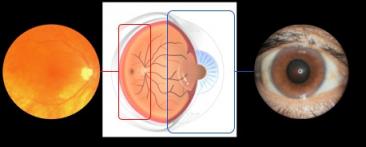

眼睛可以通过多种方式成像。糖尿病视网膜疾病筛查的一种常见方法是使用眼底照片(左)检查眼后节,这些照片已被证明含有肾脏和心脏疾病以及贫血的信号。另一种方法是拍摄眼睛前部的照片(外眼照片;右),这通常用于追踪影响眼睑、结膜、角膜和晶状体的状况。

在《自然生物医学工程》上发表的 《通过深度学习检测眼部外部照片中的疾病迹象》一文中,我们展示了深度学习模型可以从眼部外部照片(即眼球前部的照片)中提取出潜在有用的生物标记。特别是对于糖尿病患者,该模型可以预测糖尿病视网膜疾病、糖化血红蛋白升高(糖尿病血糖控制和结果的生物标记)和血脂升高(心血管风险的生物标记)。眼部外部照片作为一种成像方式特别有趣,因为它们的使用可以减少对专用设备的需求,为改善健康筛查的可及性打开各种途径。

开发模型

为了开发该模型,我们使用了来自远程糖尿病视网膜病变筛查计划的 145,000 多名患者的去身份识别数据。我们利用这些图像以及我们希望模型预测的变量的对应基本事实(即患者是否患有糖尿病视网膜疾病、糖化血红蛋白升高或血脂升高)训练了卷积神经网络,以便神经网络可以从这些示例中学习。经过训练后,该模型能够拍摄外部眼部照片作为输入,然后输出患者是否患有糖尿病视网膜疾病或血糖或血脂升高的预测结果。

该示意图显示了模型生成外部眼部照片的预测。

我们利用受试者工作特征曲线下面积(AUC) 来衡量模型性能,该曲线下面积量化了模型为真正阳性的患者分配比真正阴性的患者更高的分数的频率(即,完美模型的得分为 100%,而随机猜测的得分为 50%)。该模型检测到了各种形式的糖尿病视网膜疾病,AUC 为 71-82%,升高的 HbA1c 的 AUC 为 67-70%,升高的脂质的 AUC 为 57-68%。这些结果表明,尽管不完美,但外部眼部照片可以帮助检测和量化全身健康的各种参数。

与CDC 的糖尿病前期筛查问卷 非常相似,外部眼部照片可能能够帮助“预先筛查”人们并确定哪些人可以从进一步的确认检测中受益。如果我们根据预测风险对研究中的所有患者进行排序并查看列表的前 5%,则其中 69% 的患者的 HbA1c 测量值 ≥ 9(表明糖尿病患者的血糖控制不佳)。相比之下,在根据人口统计学和患糖尿病年限的风险评分处于最高风险的患者中,只有 55% 的患者 HbA1c ≥ 9,而在随机选择的患者中,只有 33% 的患者 HbA1c ≥ 9。

评估潜在偏见

我们强调,这是一项有希望但尚处于早期阶段的概念验证研究,展示了一项新发现。尽管如此,由于我们认为评估数据和模型中的潜在偏差很重要,因此我们采取了多管齐下的方法来评估偏差。

首先,我们进行了各种可解释性分析,旨在发现图像的哪些部分对算法的预测贡献最大(类似于我们的贫血工作)。显着性分析(检查哪些像素对预测影响最大)和消融实验(检查移除各种图像区域的影响)都表明算法受图像中心的影响最大(巩膜、虹膜和瞳孔的区域,但不是眼睑)。下图证明了这一点,从中可以看出,当图像遮挡从中心开始时(绿线),AUC 下降的速度比从外围开始时(蓝线)要快得多。

可解释性分析显示(顶部)所有预测都集中在眼睛的不同部位,并且(底部)遮挡图像中心(对应于眼球的各个部分)的效果比遮挡边缘(对应于周围结构,例如眼睑)的效果要大得多,如绿线的急剧下降所示。“基线”是一个逻辑回归模型,以自我报告的年龄、性别、种族和患糖尿病的年限作为输入。

其次,我们的开发数据集涵盖了美国境内的一系列不同地点,包括在 301 个糖尿病视网膜病变筛查点拍摄的 300,000 多张去身份识别照片。我们的评估数据集包含来自美国 18 个州 198 个站点的 95,000 多张图片,包括以西班牙裔或拉丁裔患者为主的数据集、以黑人患者为主的数据集以及包含非糖尿病患者的数据集。我们对具有不同人口统计学和身体特征(例如年龄、性别、种族和民族、是否患有白内障、瞳孔大小甚至相机类型)的患者组进行了广泛的亚组分析,并将这些变量作为协变量进行控制。考虑到这些因素后,该算法在所有亚组中的预测能力都比基线更高。

结论

这项激动人心的工作证明了从外部眼部照片中提取有用的健康相关信号的可行性,并对大量且快速增长的糖尿病或其他慢性病患者群体具有潜在影响。要实现广泛的适用性还有很长的路要走,例如了解需要什么级别的图像质量,推广到患有和未患有已知慢性疾病的患者,以及了解如何推广到使用不同相机和在各种条件(如光照和环境)下拍摄的图像。通过与EyePACS和CGMH等学术和非学术专家的持续合作,我们期待在更大、更全面的数据集上进一步开发和测试我们的算法,并扩大可识别的生物标志物范围(例如肝病)。最终,我们致力于让每个人都能更轻松地使用非侵入性健康和保健工具。

致谢

这项工作凝聚了软件工程师、研究人员、临床医生和跨职能贡献者组成的多学科团队的努力。该项目的主要贡献者包括:Boris Babenko、Akinori Mitani、Ilana Traynis、Naho Kitade、Preeti Singh、April Y. Maa、Jorge Cuadros、Greg S. Corrado、Lily Peng、Dale R. Webster、Avinash Varadarajan、Naama Hammel 和 Yun Liu。作者还要感谢 Huy Doan、Quang Duong、Roy Lee 和 Google Health 团队提供的软件基础设施支持和数据收集。我们还要感谢 Tiffany Guo、Mike McConnell、Michael Howell 和 Sam Kavusi 对稿件的反馈。最后但同样重要的是,感谢为瞳孔分割模型标注数据的评分者,并特别感谢 Tom Small 提供的构思和设计,启发了本博文中使用的动画。

评论