自 1970 年代以来,眼动研究已在视觉科学、语言和可用性 领域得到广泛研究。除了基础研究之外,更好地了解眼动还可能对各种应用有用,包括可用性和用户体验研究、游戏、驾驶和基于注视的医疗保健可及性交互。然而,进展有限,因为大多数先前的研究都集中在价格昂贵且不易扩展的专用硬件眼动仪上。

在《自然通讯》上发表的 《通过精确且经济实惠的智能手机眼动追踪加速眼动研究》和《npj Digital Medicine》上发表的《心理疲劳的数字生物标志物》中,我们介绍了基于智能手机、由机器学习驱动的精确眼动追踪技术,该技术有可能开启视觉、无障碍、医疗保健和健康等领域应用的新研究,同时还可以为世界各地不同人群提供数量级的扩展,所有这些都使用智能手机上的前置摄像头。我们还讨论了该技术作为心理疲劳的数字生物标志物的潜在用途,这有助于改善健康。

模型概述

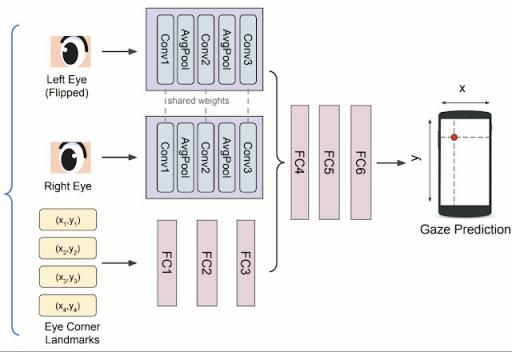

我们的凝视模型的核心是一个在MIT GazeCapture 数据集上训练的 多层前馈卷积神经网络(ConvNet) 。人脸检测算法选择了具有相关眼角标志的人脸区域,这些标志用于将图像裁剪为仅眼部区域。这些裁剪后的帧通过两个具有共享权重的相同 ConvNet 塔进行输入。每个卷积层后面都有一个平均池化层。眼角标志通过完全连接的层与两个塔的输出相结合。除最终的完全连接输出层 (FC6) 外,所有层都使用了整流线性单元(ReLU),该层没有激活。

非个性化注视模型的架构。从前置摄像头图像中提取的眼部区域作为卷积神经网络的输入。全连接 (FC) 层将输出与眼角标志相结合,通过多回归输出层推断屏幕上的注视x和y位置。

通过微调和针对每个参与者的个性化,非个性化凝视模型的准确性得到了提高。对于后者,轻量级回归模型被拟合到模型倒数第二层 ReLU 层和参与者特定数据。

模型评估

为了评估该模型,我们收集了同意的研究参与者的数据,他们观看了空白屏幕上随机位置出现的点。模型误差计算为刺激位置与模型预测之间的距离(以厘米为单位)。结果表明,虽然非个性化模型的误差很大,但使用约 30 秒的校准数据进行个性化可将误差降低四倍以上(从 1.92 厘米减少到 0.46 厘米)。在 25-40 厘米的观看距离下,这相当于 0.6-1° 的准确度,与之前研究报告的 2.4-3° 相比有显著提高 [ 1 , 2 ]。

额外的实验表明,无论是将手机放在设备支架上,还是用户将手机自由地握在手中,将手机置于近乎正面的姿势,智能手机眼动追踪器模型的准确度都可与最先进的可穿戴眼动追踪器相媲美。与每只眼睛附近都有多个红外摄像头的专用眼动追踪硬件相比,使用智能手机的单个前置 RGB 摄像头运行我们的注视模型具有显著更高的成本效益(大约便宜 100 倍)和可扩展性。

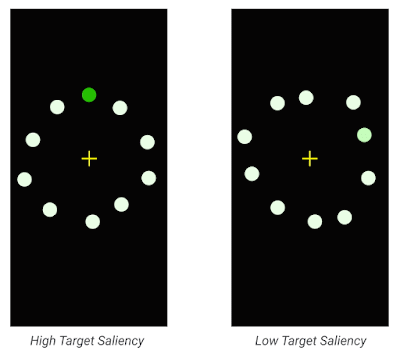

利用这项智能手机技术,我们能够复制神经科学和心理学领域先前眼动研究的关键发现,包括标准眼动任务(了解大脑的基本视觉功能)和自然图像理解。例如,在一个简单的前扫视任务中,该任务测试一个人快速将眼睛移向屏幕上出现的刺激物的能力,我们发现平均扫视延迟(移动眼睛的时间)与先前的基本视觉健康研究结果相符(210 毫秒对 200-250 毫秒)。在受控视觉搜索任务中,我们能够复制关键发现,例如目标显著性和杂乱对眼动的影响。

示例凝视扫描路径显示了目标的显著性(即颜色对比度)对视觉搜索性能的影响。需要较少的注视来找到具有高显著性(不同于干扰项)的目标(左),而需要更多的注视来找到具有低显著性(类似于干扰项)的目标(右)。

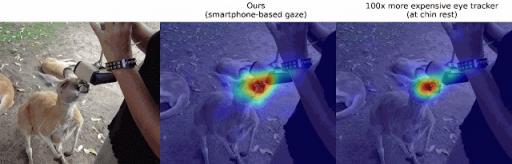

对于自然图像等复杂刺激,我们发现智能手机眼动仪的凝视分布(通过汇总所有参与者的凝视位置计算得出)与使用高度受控设置(如实验室下巴托系统)的笨重、昂贵的眼动仪获得的凝视分布相似。虽然基于智能手机的凝视热图比基于硬件的眼动仪分布更广(即看起来更“模糊”),但它们在像素级别(r = 0.74)和对象级别(r = 0.90)都高度相关。这些结果表明,该技术可用于扩展复杂刺激的凝视分析,例如自然图像和医学图像(例如,放射科医生查看 MRI/PET 扫描)。

我们的智能手机方法与更昂贵的(100 倍)眼动仪(来自OSIE 数据集)的注视分布类似。

我们发现,智能手机注视也有助于检测阅读理解的难度。阅读文章的参与者在回答正确时会花费更多时间查看相关摘录。然而,随着理解难度的增加,他们会花费更多时间查看文章中不相关的摘录,然后才找到包含答案的相关摘录。注视相关摘录所占时间的比例是理解能力的一个很好的预测指标,并且与理解难度呈强烈的负相关(r = −0.72)。

精神疲劳的数字生物标志物

凝视检测是检测警觉性和幸福感的重要工具,在医学、睡眠研究和医疗手术、航空安全等关键任务环境中得到了广泛研究。然而,现有的疲劳测试是主观的,而且往往很耗时。在我们最近发表在npj Digital Medicine上的论文中,我们证明了智能手机凝视会严重影响精神疲劳,并可用于追踪疲劳的发生和进展。

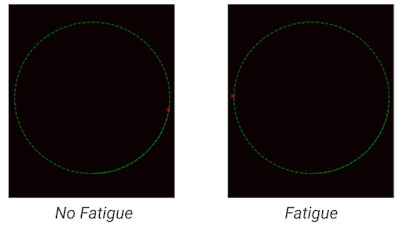

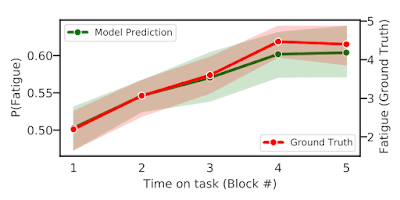

一个简单的模型仅使用参与者执行任务时几分钟的注视数据即可可靠地预测心理疲劳。我们在两个不同的实验中验证了这些发现——使用与语言无关的物体跟踪任务和与语言相关的校对任务。如下所示,在物体跟踪任务中,参与者的注视最初遵循物体的圆形轨迹,但在疲劳状态下,他们的注视显示出很大的错误和偏差。鉴于手机的普及,这些结果表明基于智能手机的注视可以提供可扩展的心理疲劳数字生物标记。

当参与者沿着圆形轨迹追踪物体时,没有疲劳的参与者(左)和有精神疲劳的参与者(右)的注视扫描路径示例。

疲劳评分(基本事实)和模型预测的相应进展作为任务时间的函数。

除了健康之外,智能手机凝视还可以提供数字表型,用于筛查或监测自闭症谱系障碍、阅读障碍、脑震荡等健康状况。这可以实现及时和早期干预,特别是对于医疗服务有限的国家。

另一个可能受益匪浅的领域是无障碍。患有ALS、闭锁综合征和中风等疾病的人言语和运动能力受损。智能手机凝视可以提供一种强大的方式,通过凝视进行交互,让日常任务变得更容易,就像最近通过“看说话”所展示的那样。

伦理考量

凝视研究需要仔细考虑,包括注意正确使用这种技术——应用程序应该获得用户的明确批准和充分知情同意,以便完成手头的具体任务。在我们的工作中,所有数据都是在用户明确批准和同意的情况下为研究目的收集的。此外,用户可以随时选择退出并要求删除他们的数据。我们将继续研究其他方法,以确保机器学习的公平性,并以负责任、保护隐私的方式提高凝视技术在不同人群中的准确性和稳健性。

结论

我们发现,基于机器学习的智能手机眼动追踪技术既准确又经济实惠,这为跨学科(例如神经科学、心理学和人机交互)眼动研究提供了数量级扩展的潜力。它们为社会带来了潜在的新应用,例如基于注视的无障碍交互,以及基于智能手机的健康和医疗保健筛查和监测工具。

致谢

这项工作涉及由软件工程师、研究人员和跨职能贡献者组成的多学科团队的合作努力。我们要感谢论文的所有合著者,包括我们的团队成员 Junfeng He、Na Dai、Pingmei Xu、Venky Ramachandran;实习生 Ethan Steinberg、Kantwon Rogers、Li Guo 和 Vincent Tseng;合作者 Tanzeem Choudhury;以及 UXR:Mina Shojaeizadeh、Preeti Talwai 和 Ran Tao。我们还要感谢 Tomer Shekel、Gaurav Nemade 和 Reena Lee 对这个项目的贡献,以及 Vidhya Navalpakkam 在发起和监督这项工作方面发挥的技术领导作用。

评论