用大量文本数据训练的语言模型彻底改变了自然语言处理 (NLP) 领域。扩大语言模型的规模通常可以提高一系列下游 NLP 任务的性能和采样效率。在许多情况下,可以通过推断较小模型的性能趋势来预测大型语言模型的性能。例如,经验表明,规模对语言模型困惑度的影响跨越了七个数量级以上。

另一方面,某些其他任务的性能并没有以可预测的方式提高。例如,GPT-3 论文表明,对于从 1 亿到 130 亿个参数的模型,语言模型执行多位数加法的能力具有平坦的缩放曲线(近似随机性能),此时性能大幅提升。鉴于语言模型在 NLP 研究和应用中的使用越来越多,更好地理解可能意外出现的能力非常重要。

在最近发表在《机器学习研究汇刊》(TMLR)上的 《大型语言模型的涌现能力》一文中,我们讨论了涌现能力现象,我们将其定义为小型模型中不存在但大型模型中存在的能力。更具体地说,我们通过分析语言模型性能与语言模型规模的关系来研究涌现能力,以总浮点运算次数(FLOP)或用于训练语言模型的计算量来衡量。然而,我们还探索了涌现能力与其他变量的关系,例如数据集大小或模型参数数量(有关详细信息,请参阅论文)。总体而言,我们展示了数十个通过扩大语言模型而产生的涌现能力的例子。这种涌现能力的存在引发了一个问题:进一步的扩大是否有可能进一步扩展语言模型的能力范围。

紧急提示任务

首先,我们讨论在提示任务中可能出现的新兴能力。在此类任务中,预先训练的语言模型会收到一个提示,提示内容为下一个单词预测,然后模型会通过完成响应来执行任务。无需进一步微调,语言模型通常可以执行在训练期间未曾见过的任务。

电影评论情绪分类的少样本提示示例。模型会获得一个任务示例(将电影评论分类为正面或负面),然后对一个未见过的示例执行该任务。

当提示任务在特定规模阈值下意外地从随机性能飙升至超随机性能时,我们称该任务为突发任务。下面我们展示了三个具有突发性能的提示任务示例:多步算术、参加大学水平的考试和识别单词的本意。在每种情况下,语言模型的表现都很差,并且几乎不依赖于模型大小,直到达到阈值,此时它们的性能突然开始出众。

执行多步算术(左)、通过大学水平的考试(中)以及识别上下文中单词的本义(右)的能力都只有足够大规模的模型才能实现。图中所示的模型包括LaMDA、GPT-3、Gopher、Chinchilla和PaLM。

只有规模足够大的模型才能在这些任务上实现非随机性能 — 例如,算术和多任务 NLU 任务的训练 FLOP超过 10 22 ,上下文中的单词任务的训练 FLOP 超过 10 24。请注意,尽管不同任务和模型的出现规模可能不同,但没有一个模型在任何这些任务上表现出平稳的行为改进。我们的论文列出了数十个其他突发事件提示任务。

紧急提示策略

第二类新兴能力包括增强语言模型功能的提示策略。提示策略是提示的广泛范例,可应用于一系列不同的任务。当它们不适用于小型模型并且只能由足够大的模型使用时,它们被认为是新兴的。

一个新兴提示策略的例子是“思路链提示”,即提示模型在给出最终答案之前生成一系列中间步骤。思路链提示使语言模型能够执行需要复杂推理的任务,例如多步骤数学应用题。值得注意的是,模型无需经过明确训练即可获得进行思路链推理的能力。下图显示了思路链提示的一个示例。

思路链提示使得足够大的模型能够解决多步骤推理问题。

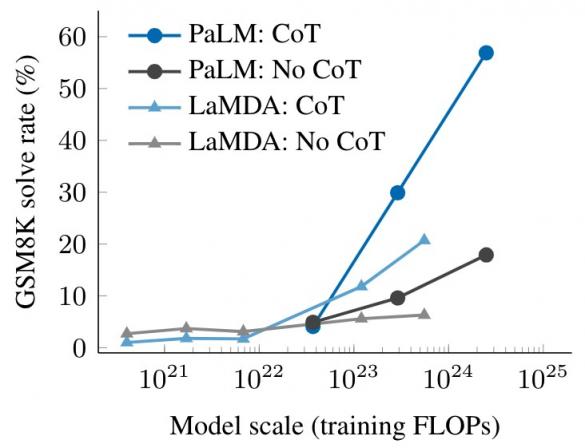

思路链提示的实证结果如下所示。对于较小的模型,应用思路链提示并不比标准提示表现更好,例如,当应用于GSM8K(数学应用题的一项具有挑战性的基准)时。然而,对于大型模型(10 24 FLOP),思路链提示在我们的测试中显著提高了性能,在 GSM8K 上的解决率达到了 57%。

思路链提示是一种新兴能力——它无法提高小型语言模型的性能,但可以显著提高大型模型的性能。这里我们说明了两种语言模型LaMDA和PaLM在不同规模下的标准和思路链提示之间的差异。

新兴能力的含义

新兴能力的存在具有一系列含义。例如,由于新兴的少样本提示能力和策略并未在预训练中明确编码,研究人员可能不知道当前语言模型的少样本提示能力的全部范围。此外,随着模型规模的扩大,新能力的出现引发了一个问题:进一步扩展是否可能赋予更大的模型新的新兴能力。

识别大型语言模型中出现的新兴能力是理解此类现象及其对未来模型能力的潜在影响的第一步。为什么扩展可以释放新兴能力?由于计算资源昂贵,是否可以在不增加扩展的情况下通过其他方法(例如,更好的模型架构或训练技术)释放新兴能力?当某些能力出现时,语言模型的新现实应用是否会被释放?随着 NLP 领域的不断发展,分析和理解语言模型的行为(包括扩展引起的新兴行为)是一个重要的研究问题。

致谢

很荣幸能够与 Rishi Bommasani、Colin Raffel、Barret Zoph、Sebastian Borgeaud、Dani Yogatama、Maarten Bosma、Denny Zhou、Donald Metzler、Ed H. Chi、Tatsunori Hashimoto、Oriol Vinyals、Percy Liang、Jeff Dean 合作,和威廉·费杜斯。

评论