图像隐私可以通过生成人工智能得到保护。来自日本、中国和芬兰的研究人员创建了一个系统,该系统将可能威胁机密性的图像部分替换为视觉上相似但由人工智能生成的替代部分。

这项名为“生成内容替换”的技术在测试中显示,60% 的观众无法分辨哪些图片被修改过。研究人员希望该系统能够为图片审查提供更具视觉凝聚力的选项,从而在保护隐私的同时保留图片的叙事性。

该项研究于 2024 年 5 月在美国夏威夷檀香山举行的计算机协会CHI 计算机系统人为因素会议上发表。

只需几个文本提示,生成式人工智能就可以快速解决棘手的学校论文、新的商业策略或无尽的模因素材。生成式人工智能进入日常生活的速度非常快,其作用和影响的潜在规模仍在努力解决。人们对其对未来就业保障、网络安全和创意原创性的影响的担忧导致了好莱坞编剧的罢工、因伪造照片而引发的诉讼以及关于真实性的激烈讨论。

然而,一组研究人员提议使用生成式人工智能的一个有时引起争议的功能——处理图像的能力——作为解决隐私问题的方法。

东京大学工程研究生院副教授 Koji Yatani 解释说:“我们发现,现有的图像隐私保护技术不一定能够在保持图像美观的同时隐藏信息。生成的图像有时看起来不自然或刺眼。我们认为这会让原本可能考虑使用隐私保护的人失去动力。”

“因此,我们决定探索如何通过结合最新的生成式人工智能技术,同时实现强大的隐私保护和图像可用性。”

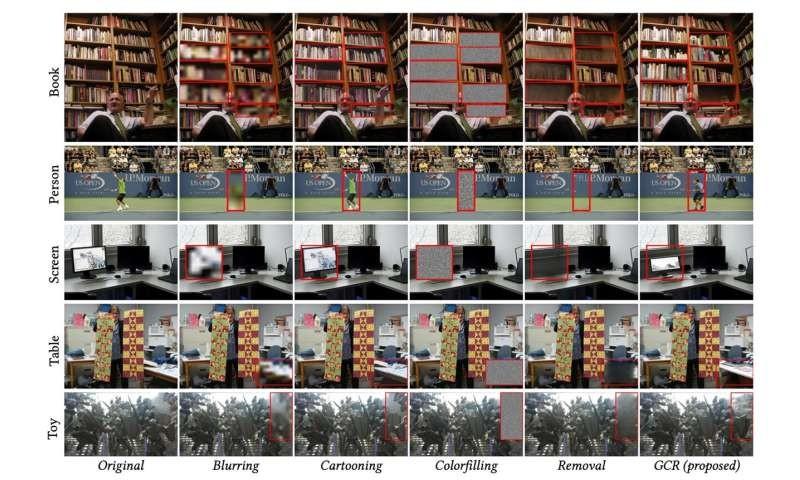

研究人员创建了一个计算机系统,他们将其命名为生成内容替换 (GCR)。该工具可识别可能构成隐私威胁的内容,并自动将其替换为真实但人为创建的替代品。例如,票根上的个人信息可能被难以辨认的字母替换,或者私人建筑可能被替换为假建筑或其他景观特征。

“有许多常用的图像保护方法,例如模糊、颜色填充或仅删除图像的受影响部分。与这些方法相比,我们的结果表明,生成内容替换可以更好地保留原始图像的故事和更高的视觉和谐度,”Yatani 说。“我们发现参与者无法在 60% 的图像中检测到 GCR。”

目前,GCR 系统需要大量计算资源,因此目前还不能在任何个人设备上使用。测试的系统是全自动的,但该团队后来开发了一个新界面,允许用户自定义图像,从而更好地控制最终结果。

尽管有些人可能担心这种逼真的图像改变的风险,即原始图像和改变后的图像之间的界限变得更加模糊,但该团队对其优势持积极态度。

Yatani 表示:“对于公众用户来说,我们认为这项研究的最大好处是为图像隐私保护提供了一种新选择。GCR 提供了一种防范隐私威胁的新方法,同时保持了叙事的视觉连贯性,并使人们能够更安全地分享他们的内容。”

本站全部资讯来源于实验室原创、合作机构投稿及网友汇集投稿,仅代表个人观点,不作为任何依据,转载联系作者并注明出处:https://www.lvsky.net/286.html

评论